Привет.

Нам постоянно твердят о том, что AI-алгоритмы меняют нашу жизнь, создают некую магию, а люди проигрывают конкуренцию компьютерам, их постепенно вытесняют на периферию. К сожалению, большая часть тех, кто говорит об этом, слабо себе представляют, как устроены алгоритмы искусственного интеллекта. Более того, они скорее говорят про искусственный интеллект, опуская слово «алгоритмы», что кардинально меняет сам смысл. У нас даже близко нет искусственного интеллекта, но существуют сотни разных алгоритмов, которые умеют решать новые типы задач, ранее недоступные для компьютеров. Но каждый из этих алгоритмов имеет изъяны, о которых не принято говорить. Компаниям стыдно признаться, что их AI-алгоритмы задействуют труд тысяч людей и без него они просто бесполезны.

Одним из первых примеров автоматизации с помощью умных алгоритмов можно считать магазины Amazon Go Grocery в США, первый такой супермаркет появился как пилотный проект в 2018 году.

Пилотный проект оказался не слишком удачным, насытить пространство камерами, которые отслеживают покупки, оказалось не так просто и легко. Добавим сюда проблему воровства товаров, которая с каждым годом становится все более актуальной во всем мире. Для Европы уровень воровства может составлять до одного процента от оборота. Например, торговая сеть Jumbo, работающая в Нидерландах и Бельгии, имеет более 700 магазинов. Компания сделала ставку на системы самообслуживания, когда покупатели самостоятельно сканируют товары и могут их оплатить на кассах самообслуживания. В 2023 году это привело к тому, что потери от кражи товаров составили около 100 млн евро. Доход торговой сети после уплаты налогов составил 80 млн евро. То есть уровень воровства превысил доходы компании, что выглядит иронично. Тут нельзя заниматься арифметикой и считать, что компания ничего не заработала, — прибыль как раз составила 80 млн евро, но она могла быть выше, если бы воровали меньше. Генеральный директор Jumbo Тон ван Вин (Ton van Veen), прокомментировал эту ситуацию следующим образом: «Мы часто ловим людей, которые не сканируют товары или не платят на кассе. Люди становятся все более изощренными в том, как не платить за продукты. Иногда ты впадаешь в шок, видя, насколько творчески люди воруют продукты, не платя за них». Примерно треть украденных продуктов связана с системой самостоятельного обслуживания.

В США ситуация сходная, за одним исключением — размер бедствия намного выше. Исследование Capital One, проведенное для 2022 года, показывает, что объем убытков от воровства составляет 86.6 млрд долларов. Примечательно, что в этой работе утверждается, что 9% американцев воруют в магазинах, а попадается только один воришка на сто случаев. Представили объем бедствия? И в таких условиях Amazon попыталась создать систему, которая будет полагаться исключительно на камеры. Очень быстро выяснилось, что объем воровства резко вырос. Проектировали систему, держа в голове обычных покупателей, которые не стремятся украсть товары, не прикрывают их от камер, не рассовывают по карманам. Жизнь оказалась намного интереснее.

После покупки WholeFoods со стороны Amazon проект Amazon Go изменился — теперь в нем возникли тележки самообслуживания, которые должны были сканировать товары без участия человека. Назвали такие магазины Amazon Go Grocery.

В конечном итоге Amazon Go Grocery закрываются ровно по той же причине, слишком дорого стоят камеры, система распознавания товаров и их поддержки. Но главное, что еще требуется содержать порядка тысячи человек в Индии, которые проверяют покупки по камерам, смотрят за посетителями. Без участия этой армии соглядатаев система просто не работала. И попытки научить ее работать без человека оказались провальными. В условиях кризиса Amazon отказалась от мечты построить полностью автоматический магазин, где не нужен персонал для обслуживания посетителей, прогресс не случился. И теперь будет идти возврат к старым, проверенным форматам работы, когда люди выполняют основные операции в магазине. Люди оказываются надежнее сложных и дорогих систем.

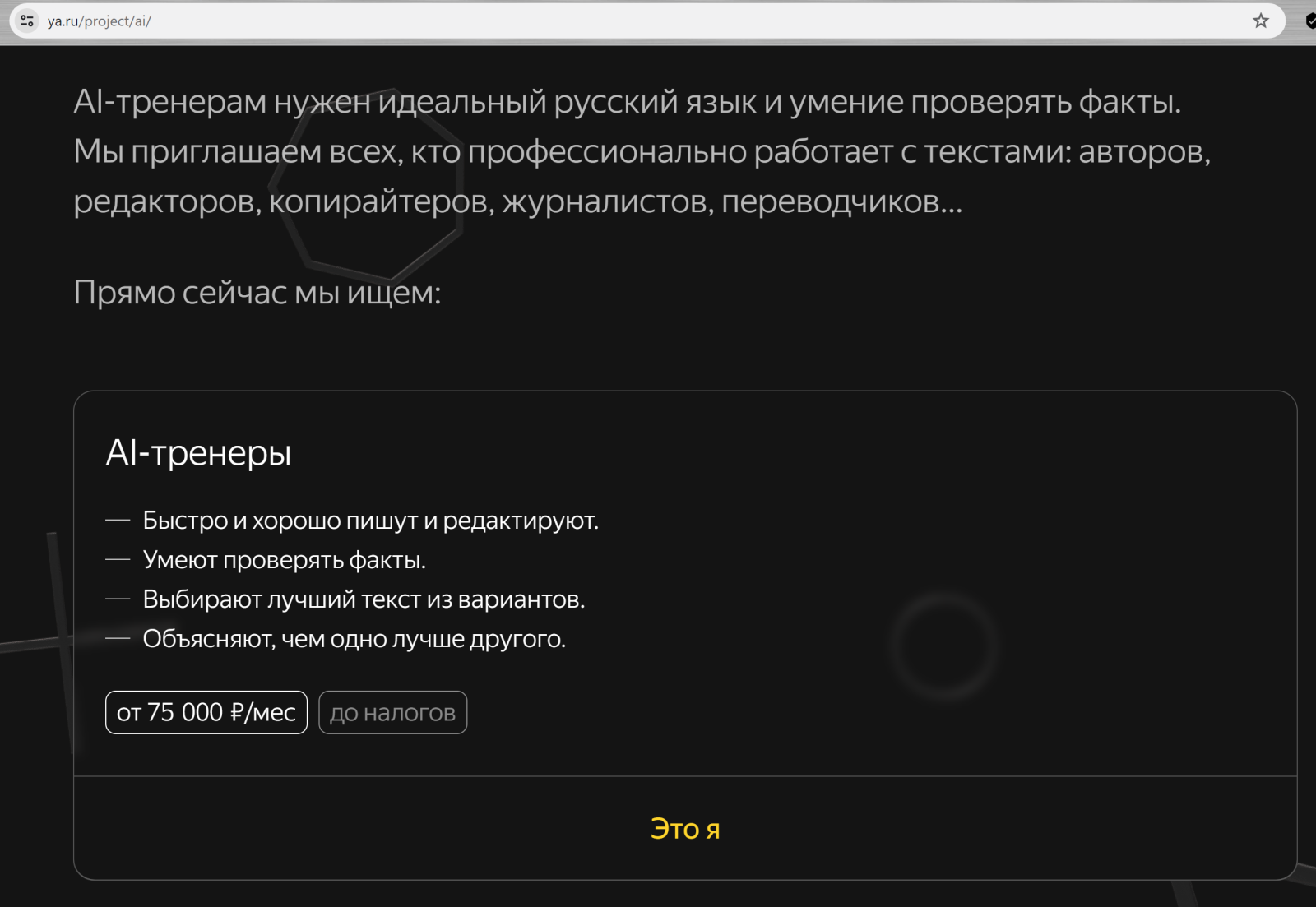

В России одной из компаний, что ассоциируются с AI-алгоритмами, является «Яндекс», у компании есть набор на позицию AI-тренера.

Задача такого тренера — писать тексты, изучать то, что создает нейросеть, и показывать последней, что у нее получилось хорошо, а что совсем никуда не годится. Тренировка AI-алгоритмов — важная составляющая обучения. Давайте разберемся на примерах, что именно делают такие тренеры. Например, возьмем недавний случай, когда у Алисы в колонке спросили, почему Маша из мультфильма живет одна, и получили ответ: «Она всего лишь призрак убитой девочки, и именно поэтому она не растет, и видеть ее могут только животные. Родители же не смогли выдержать потери ребенка и уехали, оставив пустой дом. А мучает Маша медведя, потому что он и лишил ее жизни». После публичного обсуждения такой вариант ответа был заблокирован, теперь Алиса отвечает иначе.

На первый взгляд кажется, что этот ответ сгенерирован нейросетью и ошибки тут нет. Но это вовсе не нейросеть от «Яндекса» (точнее, не «Яндекс» для Алисы создал этот ответ). В поисковой выдаче мы можем найти такой ответ, он один из первых.

Для ответов Алисы используется чужой контент, который «Яндекс» ищет в сети и указывает источник, обычно это звучит так: «Информация с сайта такого-то, вот что я нашла». И это вовсе не информация, которую формирует сама компания. Проблема тут в том, что многие начали использовать нейросети для того, чтобы автоматически создавать страницы на популярные темы, отвечать на вопросы бытия, и зачастую они заполняют первые строчки поисковой выдачи. В той же Google пытаются бороться с этим. Недавно рассказывал о том, как полки онлайн-магазинов заполнили «книги», которые ежедневно сотнями создаются нейросетями.

Классический поиск сломался, так как он не был рассчитан на то, что интернет заполнят миллионы страниц, «написанных» нейросетями. Задача тех же AI-тренеров в «Яндексе» и заключается в том, чтобы определять такие ситуации, исправлять их, показывать алгоритмам, что правильно и хорошо, а что плохо. Вот только число людей значительно меньше, чем появляющихся текстов и угроз извне, они просто не справляются с объемом работы.

Неоднократно видел утверждения, что «Яндекс», давая тестовые задания для соискателей на позицию AI-тренера, использует бесплатный труд (написание текстов всегда на разные темы). И что практически никто работу в итоге не получает. Знаю многих людей, которые такую работу получили, но отбор действительно довольно жесткий, а претендентов очень много. Насколько нужны тестовые задания, чтобы тренировать AI-алгоритмы, неясно, но возможно, что их тренируют и так. Не вижу в этом ничего криминального, соискатели сразу соглашаются на то, что они пробуются на это место и де-факто отдают свои тестовые задания без каких-либо условий.

Обратите внимание, что компании и раньше применяли пользовательские данные для тренировки алгоритмов. Бесплатное место в облаках для фотографий и видео, чтобы на них тренировать свои сервисы, — первой это начала делать Google, затем другие компании. Но не все алгоритмы можно натренировать без участия человека, большая часть нуждается в подсказках. Почему это так, можно прочитать в книге «Кокетливый интеллект».

Представление о том, что можно создать некий AI-алгоритм и он заменит множество людей, страдает однобокостью. Безусловно, есть такие алгоритмы, которые, выполняя рутинные задачи, могут заменить людей. Проблема тут в том, что до того, как их можно будет выпустить на волю, необходимо их научить правильно работать, а для этого нужны люди, и это непростая задача, и она обходится дорого. Например, в Нью-Йорке запустили чат-бот с AI-алгоритмами для помощи бизнесу, MyCity должен давать справочную информацию о законах в этом городе. На деле он зачастую дает ошибочную, неверную информацию. Искушение создать справочный чат-бот было слишком велико, а результат никто не проверял. И это один из тысяч примеров того, что заменить человека алгоритмы не могут, получается у них не очень хорошо. Чтобы AI-алгоритмы работали, требуется их доведение до ума, настройка, и тут не обойтись без людей. Иногда стоимость доведения алгоритмов до нормального состояния так высока, что проще от них отказаться.