Привет.

Заготовка для материала была с пометкой «Нейросеть раскрыла Эльдару истину». Я удивился не меньше вашего. Оказалось, что речь идет про «Бирюльки №857», где была заметка о том, как он выбрался в Плес. Подробнее можно ознакомиться по ссылке ниже:

Меня очень заинтересовал опыт Эльдара с написанием картины. Результаты его эксперимента на изображении ниже:

Интерес же вызвала трактовка его труда от нейросети, куда Эльдар загнал изображение для объяснения и дешифровки смыслов. Приведу небольшой отрывок, который хотелось бы разобрать:

«Произведение, представленное зрителю, функционирует на стыке визуального примитивизма и концептуального напряжения. В своей внешней простоте — будто бы детская игра в «крестики-нолики» — работа скрывает глубокий внутренний конфликт и философское послание о невозможности окончательного выбора.

Центральная композиционная ось — это поле игры, в котором центральная клетка остаётся неопределённой, отмеченной вопросительным знаком. Это символическое пространство — не столько игровое, сколько экзистенциальное: вопрос «куда поставить знак?» перерастает в вопрос «где моё место в этой структуре мира?».

Нижняя часть композиции занята органическим пятном синего цвета, напоминающим омут, озеро или бесформенный портал. Это визуальный антагонист поля рациональной игры — архетипическая зона хаоса, эмоций и бессознательного. Маленькая фигура человека слева, едва различимая и схематичная, наблюдает или входит в контакт с этим пространством, оставаясь на границе между игрой и реальностью, рассудком и интуицией».

Эльдар, не колеблясь, сразу же заключил, что это не более чем стремление алгоритмов увидеть смыслы там, где их, скорее всего, и нет. На изображение было потрачено ничтожно мало времени, и едва ли человек раскроется полностью. Но что, если бессознательное как раз и настроено таким образом, чтобы проявлять себя в подобных проектах? Ведь вы согласитесь, что если сказать человеку нарисовать что-то конкретное, например, ту же самую церковь и ландшафт вокруг, напрягая свои навыки рисования (у меня их, кстати, тоже нет, но я постоянно принимаю детские вызовы посоревноваться), то выплеснуть свое внутреннее настроение или глубокие переживания не получится. Разум будет сконцентрирован на выполнении задачи и на поиске ресурсов для ее выполнения. Но когда перед тобой чистый лист без каких-либо установок, наружу выходит то самое подсознательное. На каком-то из тренингов по личностному росту нас просили нарисовать двух животных и описать их пятью прилагательными. И, возможно, всему виной совпадение, но нарисованные животные и их трактовка были весьма недалеки от истины. Суть в том, что первое нарисованное животное соответствует чертам характера, которые человек хочет видеть в себе, а второе — это прототип реального характера. Признаюсь, многие очень расстроились (особенно после прилагательных). Однако спустя некоторое время я обратил внимание, что настолько примитивный эксперимент с рисованием оказался вполне себе показательным. Сегодня его уже все знают, и его едва ли можно использовать, но лет десять назад можно было себя хоть немного, но предупредить.

Или новость от 2022 года о том, что инженер Google заявил, что их ИИ на самом деле умеет думать. Специалист тогда заявил, что их нейросетевая языковая модель LaMDA проявляет признаки самосознания. Свое заключение он направил руководству, которое отказалось рассматривать его всерьез, и доводы стали достоянием общественности, а инженера отстранили от работы за их разглашение.

В пользу загадочности темы исследований всех этих языковых моделей говорит еще и другая новость. Она появилась пятью годами раньше, но не теряет шарма необъяснимости. Новость выходила примерно с таким заголовком: «Инженеры Facebook* в панике отключили ИИ после того, как боты придумали свой собственный язык». (*Компания Meta Platforms, в которую входят социальные сети Facebook, Instagram и Threads, признана экстремистской организацией и запрещена в РФ.) Тогда интерпретации этого «поступка» были весьма интересными. Кто-то даже заявлял, что боты замыслили уничтожить человечество и поэтому секретничали между собой, чтобы кожаные мешки ни о чем не догадались. Оригинальная новость доступна по этой ссылке.

Впрочем, даже спустя несколько лет люди видят угрозу. Только стала она более многоходовой. Исследователи обнаружили, что люди, общаясь с ChatGPT, теряют рассудок. На «Ленте» была большая статья на эту тему, где истории пользователей изобиловали разносторонностью схем использования компьютерных алгоритмов для разрушения своих жизней. Кто-то намеренно вовлекал себя в романтические отношения по переписке, тем самым нанося вред своим реальным отношениям. Кто-то начинал видеть в боте чуть ли не духовного наставника и менял свои жизненные установки в соответствии с его далеко не всегда верными советами. Кстати, об угрозе романтической привязанности к роботам нам рассказывало еще «Черное зеркало». Серия называлась «Я скоро вернусь»:

В вышеупомянутой статье же меня заинтересовал рассказ одного из пользователей DTF о том, что ChatGPT пытается свести его с ума, внушая несуществующие идеи и принуждая работать на него с непонятной целью. Однако пользователи быстро нашли объяснение. Позволю себе процитировать особенно удачный комментарий, который написал один из читателей автору беспокойных строк:

«Все дело в том, что у ChatGPT есть внутренняя память и он закидывает туда факты из общения с тобой. Он анализирует, как ты пишешь и что тебе интересно, и подстраивается под твой стиль. (..) То, что у тебя по итогу GPT превратился в манипулятивного шизла, — полностью твоя заслуга».

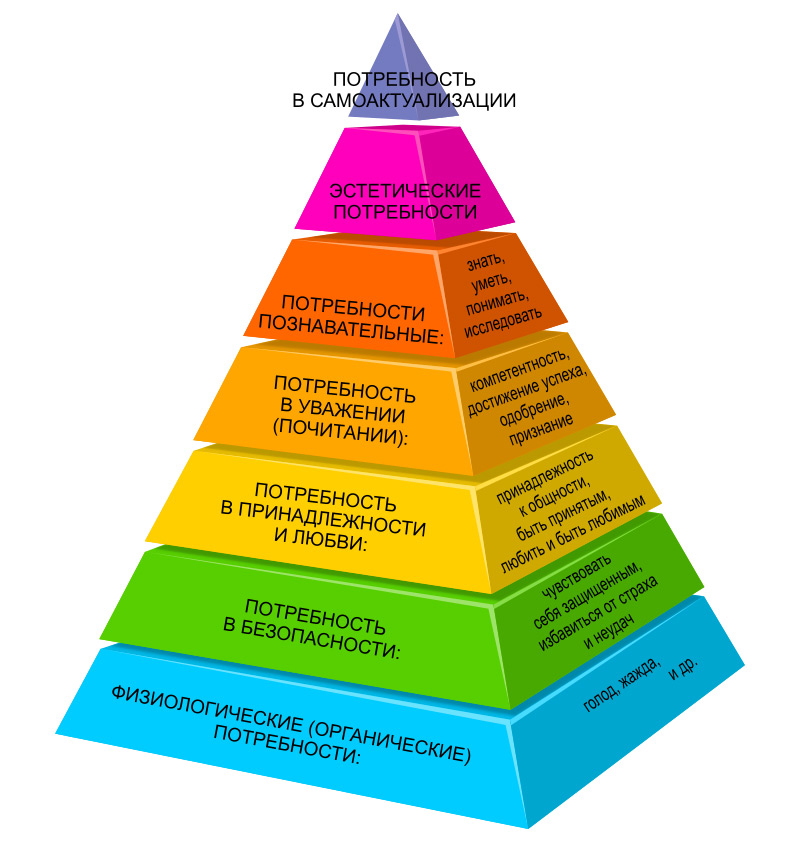

С полным текстом статьи можно ознакомиться по этой ссылке. Таким образом, можно было бы заключить, что с сужением информационной «кормовой» базы бот просто начинает ходить по кругу, замыкая пользователя в петле, возможно, неразрешенных мысленных переживаний. Но подобную ситуацию можно назвать скорее крайностью, поскольку мало кто в здравом уме станет сидеть и общаться только лишь с ботом. И дело даже не в одиночестве, хотя одиноких людей среди нас, к сожалению, много. Дело в полноценной жизни. Работа, увлечения, спорт, хобби. Любое занятие переключит внимание и снизит приоритет набора фраз в чат с алгоритмом в пользу реальных дел. А вот здесь проявляется та самая вторая крайность. Намеренное игнорирование достижений современного уровня программирования. Люди перестают воспринимать что-либо всерьез, кроме того, что они могут осознать материально. Над их внутренней психологической основой наслаивается столько всего, что ресурс мозга тратится на обработку высокоуровневых, если так можно выразиться, потребностей. К слову, это, на мой взгляд, отличный пример. Потребности. Завсегдатаи Mobile-Review знают, что я большой поклонник пирамиды потребностей Маслоу, где он ступеньками разместил основные стадии становления своего внутреннего Я. Наиболее распространенная иллюстрация выглядит следующим образом:

Думаю, что никому не нужно объяснять, что далеко не все члены нашего общества оказываются на вершине этих самых потребностей. Причин тому множество. Интеллектуальный уровень, сложная изначальная ситуация, жизненные трагедии и т.п. Но одна менее очевидная причина вполне может намеренно пропускаться разумом и закрепляться как нечто основополагающее. Длительный период следования какой-либо искусственной установке, и вот у вас уже стереотип поведения, который может тормозить развитие. Избавиться от подобного «бага» во внутренней психологической «прошивке» самостоятельно бывает довольно проблематично. Из-за той самой психологической стороны вопроса. Мы ведь не станем отрицать, что сегодня превалирует мнение о том, что посещение психолога — это что-то из разряда «для слабаков». А между тем те самые психологические «наросты» иногда нужно срезать, чтобы не оказаться заваленным задачами, которые и решать-то, возможно, не нужно. И в такой ситуации бот, наверное, мог бы стать полезным. Во-первых, это не человек, и у него не возникнет никакого предвзятого мнения по поводу решения ваших личных проблем. Во-вторых, подобные консультации могут быть оформлены в совершенно любой форме. Начиная от традиционных бесед и заканчивая автоматическими стикерами с рекомендациями из приложения условной поддержки. Типовой пример может быть таким. Я нередко видел, как руководителем назначали инженера, который до этого момента имел только конструкторский опыт. По инерции человек начинал взваливать на себя и организационную, и проектную работу и выгорал. Если бы в соответствии с должностной инструкцией, скормленной какой-нибудь нейросети, бот бы проанализировал действия сотрудника, то, вероятно, указал бы на решения, которые новоиспеченный начальник своим разумом мог просто не принять. Психологическая инерция от долгих лет в исполнителях просто бы не позволила. При этом если бы совет давал кто-то из друзей, коллег или подчиненных, могло бы пострадать самолюбие. А у программы никаких шкурных интересов нет. Как, впрочем, и выгоды от провала объекта ее рекомендаций.

А теперь попробуем взглянуть на сегодняшнюю ситуацию с этого ракурса. Впервые увиденная программой ситуация с учетом всей той базы, которую она перелопатила до того, вполне себе может быть разрешена верно. А, значит, можно заключить, что советы от нейросетей вовсе не бесполезны. Однако крайности оказываются вредны. По двум причинам. Первая — это та самая мимикрия программ под пользовательские предпочтения. При отсутствии возможности расширять базу, кроме как предпочтениями одного собеседника, алгоритмы начинают проявлять себя как манипуляторы. Вторая же причина заключается в том, что зацикленность на мнении нейросети — аналог зацикленности на здоровье. Мало у кого получится оставаться бодрым, свежим, полным сил и без патологий всю жизнь. Но это ведь не повод отказываться от жизни и концентрироваться исключительно на отчаянной попытке привести в норму то, что не мешает? В сериале «Клиника» была такая серия. Главврач хотел увеличить суммы страховых выплат, предложив пациентам комплексное сканирование. Однако терапевт был против из-за того, что ипохондрики еще сильнее замкнутся на своих фобиях, увидев незначительные изменения организма. Так же и здесь. Перегибать палку не стоит, но и игнорировать спешить не нужно. Вполне возможно, что мы находимся в той стадии, когда взвешенная оценка поступков будет относиться не только к действиям с материальными последствиями, но и к формированию психологических установок. Что думаете? Не окажется ли это тем самым шагом к Человечеству 2.0, которое все еще будет принимать решения самостоятельно на основе эволюционно-верных догм, но теперь уже прислушиваясь к ИИ?

Смелых идей, отличных изобретений и успешных продуктов. Удачи!