Примечание редакции Mobile-review.com. Мы подбираем материалы в раздел «Мнение», чтобы показать то как воспринимают рынок, компании в других странах. Мнения в таких материалах зачастую не совпадает с взглядами нашей редакции, но дают понимание рынка, его медийной составляющей.

По материалам Phonearena

Искусственный интеллект — без сомнения, фраза года и самое модное явление. Мы постоянно слышим эту аббревиатуру, и иногда она используется самым нелепым образом: ИИ-мыши, ИИ-зубные щетки, ИИ-алгоритмы подбора парфюмерии и даже обувь, оснащенная ИИ.

Здесь же речь пойдет о месте ИИ в современных смартфонах. Но для начала – что вообще такое искусственный интеллект?

Искусственный интеллект (ИИ) — это область информатики, связанная с созданием систем, способных выполнять задачи, которые обычно требуют участия людей, таких как рассуждение, обучение, решение проблем, восприятие, понимание языка и многое другое. Системы искусственного интеллекта используют алгоритмы и данные для имитации разумного поведения.

Ключевое слово здесь — «имитация». Системы искусственного интеллекта не могут «понимать» данные, а их логика и рассуждения основаны на алгоритмах.

Представьте, что вы находитесь в комнате. На одной из стен есть две щели и одна щель на противоположной стене, над ней мигают красная и зеленая лампочки. Каждую минуту из первых двух щелей выходит два листа бумаги с китайскими иероглифами.

Вы не знаете китайского языка и понятия не имеете, что это значит. Вы берете один из листов и помещаете его в щель с лампочками. Загорается зеленый свет. Вы сделали что-то правильно. Если загорится красный свет, вы запомните форму иероглифа и в следующий раз, когда увидите, что он выходит из первых двух щелей, не станете совать этот лист во вторую.

Это очень упрощенный пример того, как работают алгоритмы ИИ. У них нет знаний или понимания информации, которую они обрабатывают, но они очень хорошо умеют распознавать закономерности и повторять или моделировать их.

Системы искусственного интеллекта также не имеют «желаний» или «мотивации» за пределами предопределенных алгоритмов. Они ничего не могут сделать по своей воле, потому что для этого потребуется сознание. Ведутся серьезные споры о том, сможем ли мы когда-нибудь создать сознательные системы (биологические или машины), но сейчас речь не об этом. Поговорим о том, в чем хорош нынешний искусственный интеллект.

Примеры систем на основе ИИ

Как уже говорилось, ИИ хорошо распознает закономерности. Он может обрабатывать огромные наборы данных, например, медицинскую информацию в виде снимков и результатов анализов, и распознавать возможные заболевания. ИИ может распознавать закономерности в финансовой сфере и помогать вам торговать, выявлять мошенничества и оценивать риски.

Но, возможно, самой интересной и популярной функцией ИИ в наши дни является его способность распознавать и понимать естественный человеческий язык. Отсюда и появление больших языковых моделей, чат-ботов и других помощников на основе искусственного интеллекта.

Некоторые могут возразить, что перевод и расшифровка в режиме реального времени были доступны задолго до появления искусственного интеллекта, но теперь, когда эти системы стали способны понимать контекст, конечный результат намного лучше. Вы также можете использовать ИИ для пересказа текста или заставить писать или рисовать за вас, а это уже создание контента.

Распознавание лиц теперь стало намного точнее благодаря ИИ, к добру или нет, и ИИ может легко находить закономерности и предлагать контекстную информацию, адаптированную к конкретным потребностям человека.

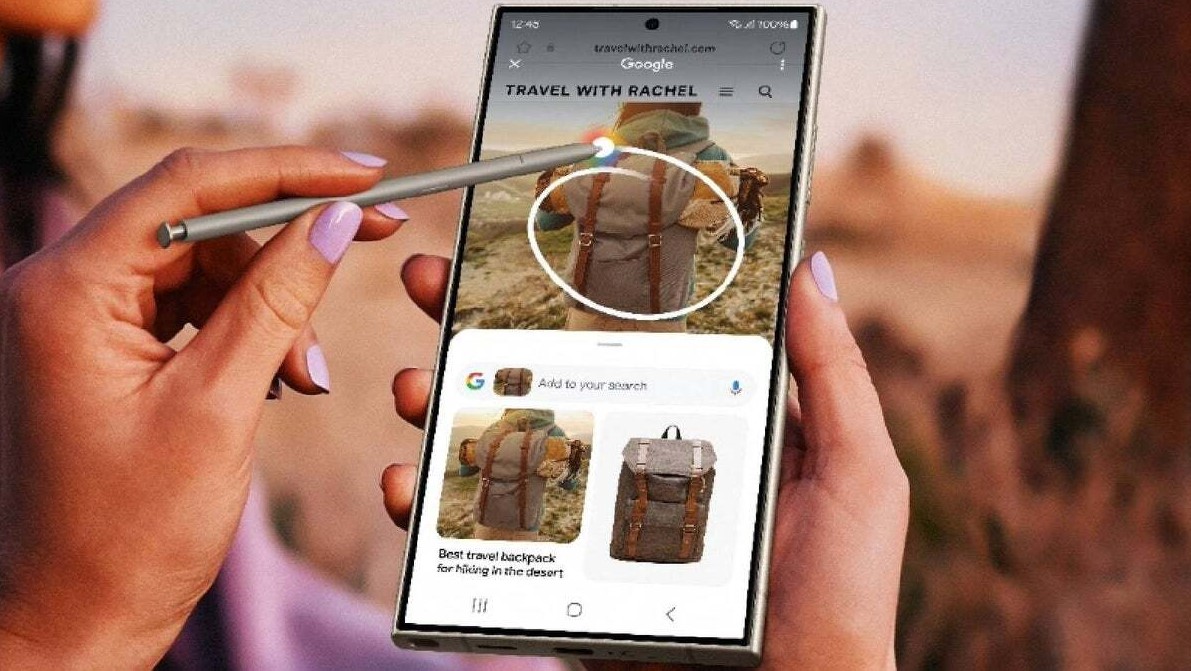

Навигационные системы теперь также используют искусственный интеллект, и они стали лучше, чем когда-либо. К ним также относятся системы беспилотного вождения, которые используют компьютерное зрение для распознавания объектов. Компьютерное зрение — это механизм, лежащий в основе Circle to Search и других систем поиска изображений. ИИ способен понимать изображения и интерпретировать их.

Итак, искусственный интеллект окружает нас повсюду и в ближайшее время никуда не денется. Давайте посмотрим, что нам доступно в наших смартфонах.

ИИ в смартфонах

Каждая компания-производитель смартфонов, крупная или не очень, стремится поучаствовать в гонке искусственного интеллекта. Google, например, представила такие функции на базе искусственного интеллекта, как Magic Editor для заполнения фона и редактирования объектов, а также Best Take, который объединяет несколько изображений для создания лучшего варианта группового фото. У Samsung есть собственный Object Eraser, предназначенный для удаления объектов с фотографий, а также некоторые умные функции Galaxy AI, такие как перевод в реальном времени во время звонков, предложения по редактированию фотографий и создание сводок как в «Заметках», так и во время просмотра.

OnePlus представила AI Summarizer для кратких выжимок телефонных звонков, а у Honor есть собственная система Magic Portal, которая может извлекать текст и изображения и отправлять их в приложения и сервисы.

Еще одна горячая тема, о которой постоянно говорят производители смартфонов, — «ИИ на устройстве». О другом типе, облачном ИИ, похоже, больше молчат, и для этого есть веская причина. Давайте разбираться.

ИИ на устройстве

Искусственный интеллект на устройстве – термин, объясняющий сам себя и означающий, что система работает на смартфоне. Она может использовать выделенный процессор или часть основного процессора, но важно то, что такой системе теоретически не требуется подключение к Интернету для работы, поскольку все вычисления выполняются на самом смартфоне.

Например, чип Google Tensor имеет специальный EdgeTPU (тензорный процессор) для ускорения выполнения задач ИИ, а Qualcomm включила новый AI Engine для поддержки до 10 миллиардов параметров генеративных моделей ИИ — исключительно на устройстве – в чипсет Snapdragon 8 Gen 3.

Модель искусственного интеллекта на устройстве имеет множество преимуществ, и это одна из причин, по которой многие компании громко о ней заявляют (хотя в большинстве случаев их системы являются гибридными, но об этом чуть позже).

Преимущества ИИ на устройстве:

Меньшая задержка: запрос обрабатывается немедленно, поскольку данные не нужно отправлять на сервер и обратно, что ускоряет получение ответа.

Конфиденциальность: данные остаются на устройстве, что снижает риск утечки данных и обеспечивает лучшую конфиденциальность пользователям.

Автономная функциональность: система может работать без подключения к Интернету, что делает ее полезной в удаленном или нестабильном сетевом окружении.

Пропускная способность: снижает потребность в постоянной передаче данных, экономя на использовании данных и снижая нагрузку на сеть.

Недостатки:

Ограничения со стороны аппаратных возможностей устройства, таких как вычислительная мощность, оперативная и встроенная память.

Управление обновлениями. Усложняется развертывание обновлений моделей и алгоритмов на множество устройств.

Масштабируемость: масштабировать сложнее, поскольку каждое устройство должно самостоятельно производить вычисления.

Искусственный интеллект на устройстве — это святая святых безопасности и самодостаточного опыта работы с искусственным интеллектом, поскольку никакая информация (теоретически) не отправляется в облако. Однако какими бы мощными ни были наши смартфоны, они просто не способны конкурировать с отдельным дата-центром с сотнями процессоров, выполняющих задачи искусственного интеллекта.

Облачный ИИ

Облачные системы искусственного интеллекта запускают модели ИИ и обрабатывают данные на удаленных серверах, размещенных в дата-центрах. Ваш смартфон должен быть подключен к Интернету, чтобы обмениваться запросами с этими дата-центрами, и в большинстве случаев через Интернет передаются не только запросы, но и некоторые пользовательские данные для выполнения поставленной задачи.

Облачный ИИ является очень мощным, поскольку он использует огромную вычислительную мощность дата-центров, специально разработанных для работы с ИИ. Однако у таких систем есть недостатки и проблемы с безопасностью.

Преимущества облачного ИИ:

Доступность ресурсов. Доступ к практически неограниченным вычислительным ресурсам, позволяющий использовать более сложные и крупные модели.

Масштабируемость. Легче масштабировать вычислительную мощность и хранилище по мере необходимости, не ориентируясь на возможности отдельных устройств.

Управление. Легче управлять, обновлять и обслуживать модели и алгоритмы централизованно.

Агрегация данных. Облегчает сбор и обработку больших наборов данных из нескольких источников.

Недостатки:

Возможны задержки из-за передачи данных в облако и из облака.

Проблемы конфиденциальности. Данные необходимо передавать на внешние серверы, что вызывает беспокойство по поводу безопасности и конфиденциальности данных.

Зависимость от интернет-соединения. Требуется стабильное подключение к Интернету, что может быть ограничением в определенных ситуациях.

Стоимость. Может означать более высокие расходы из-за оплаты передачи данных и использования места в облаке.

Понятно, почему компании не так много говорят об облачном ИИ, особенно сейчас, когда люди очень чувствительны к использованию своих личных данных. Еще одна потенциальная проблема заключается в том, что такие системы наверняка перейдут на модели подписки после первых нескольких лет хайпа.

Гибридный ИИ

На самом деле большинство компаний-производителей смартфонов используют гибридную модель искусственного интеллекта, то есть некоторые функции доступны на вашем смартфоне, а некоторые используют удаленный дата-центр. Ряд функций искусственного интеллекта также зависят от подключения к Интернету, например Circle to Search. Без интернет-соединения вы вообще ничего не сможете найти.

Самое неприятное то, что эти гибридные модели имеют тенденцию подключаться к облаку даже при использовании встроенного чипсета, а когда вы отключаетесь от интернета, некоторые предположительно встроенные функции перестают работать.

Например, Galaxy AI использует искусственный интеллект на устройстве для подсказок по фотогалерее, но подключается к облаку для генеративной обработки фотографий. Он использует оба метода для расшифровки речи в текст и перевода в реальном времени.

Понять, что и как, помогает таблица, размещенная на сайте компании:

| Приложение Samsung | ИИ-функция | Обработка по умолчанию | Обработка с включённой политикой безопасности |

| Телефон | Текстовый звонок Синхронный перевод | На устройстве На устройстве | На устройстве На устройстве |

| Переводчик | Перевод | На устройстве | На устройстве |

| Клавиатура Samsung | Подсказки в чатах1 Перевод Тон письма Правописание | На устройстве На устройстве Гибридный2 Гибридный2 | На устройстве На устройстве На устройстве3 На устройстве3 |

| Заметки | Правописание Резюме Автоформат Перевод | Облачный Облачный Облачный На устройстве | Недоступно Недоступно Недоступно На устройстве |

| Диктофон | Распознавание речи Резюме Перевод | На устройстве Облачный На устройстве | На устройстве Недоступно На устройстве |

| Обои | Генерация обоев Таймлапс и погода | Облачный На устройстве | Облачный На устройстве |

| Редактор изображений | Генеративное редактирование | Облачный | Недоступно |

| Галерея | Умное редактирование Instant Slow-mo | На устройстве На устройстве | На устройстве На устройстве |

| Samsung Internet | Резюме Перевод | Облачный На устройстве | Недоступно На устройстве |

1 Доступно в мессенджерах типа Samsung Messages или WhatsApp.

2 Английский и корейский обрабатываются на устройстве. Все прочие языки обрабатываются в облаке.

3 Доступно только для английского и корейского языков.

Некоторые компании также довольно расплывчато говорят о том, какие функции выполняются на устройстве, а какие требуют доступа в Интернет, так что нам могут потребоваться новые правила, чтобы пользователей не вводили в заблуждение.

Заключение

Искусственный интеллект с нами надолго, без вариантов. И прежде всего он облегчит нам жизнь. Некоторые люди сравнивают ИИ-революцию с индустриализацией или интернет-революцией, и, возможно, они на правильном пути с подобными аллегориями.

Однако есть не столь очевидная проблема — то, как мы используем такие системы, а не только конфиденциальность и безопасность. Наша зависимость от ИИ может привести к тому, что некоторые наши навыки устареют и со временем могут быть потеряны. Нам не нужно будет учить иностранные языки, учиться пользоваться картой, пересказывать прочитанное и редактировать изображения. А к чему это приведет, предсказать пока сложно.