Примечание редакции Mobile-review.com. Мы подбираем материалы в раздел «Мнение», чтобы показать то как воспринимают рынок, компании в других странах. Мнения в таких материалах зачастую не совпадает с взглядами нашей редакции, но дают понимание рынка, его медийной составляющей.

По материалам Android Central

Во время мероприятия Galaxy Unpacked 2025 представители компаний Samsung и Google упоминали нечто, о чем мы еще не слышали применительно к смартфонам: агентный ИИ.

Возможно, он ускользнул и от вашего внимания, поскольку о нем не было сказано ничего, кроме названия, зато много говорилось о том, как он сможет работать в новых смартфонах линейки Galaxy S25. Он играет важную роль во всем этом новейшем и умнейшем ПО под названием Galaxy AI.

Агентный ИИ – новая технология, но не самая-самая свежая и передовая. Она уже давно используется на фабриках и предприятиях с высокой степенью автоматизации.

Если попробовать объяснить, что это такое, получится скучновато: вероятностная технология, которая адаптируется к изменяющимся условиям и событиям. Но на самом деле это ни разу не скучно! Суть в том, что это смесь большой языковой модели, машинного обучения и автоматизации (программной или аппаратной), которая может сформировать полуавтономный ИИ, который будет анализировать данные, мгновенно ставить задачи и предпринимать соответствующие действия для достижения поставленных целей.

Выглядит как новый шаг к пугающему очеловечиванию ИИ, но до этого мы еще не дошли. Пока. Но так можно создать агента ИИ, который будет больше похож на человека, когда вы взаимодействуете с ним, и сможет лучше отвечать вашим потребностям, в определенных рамках, конечно.

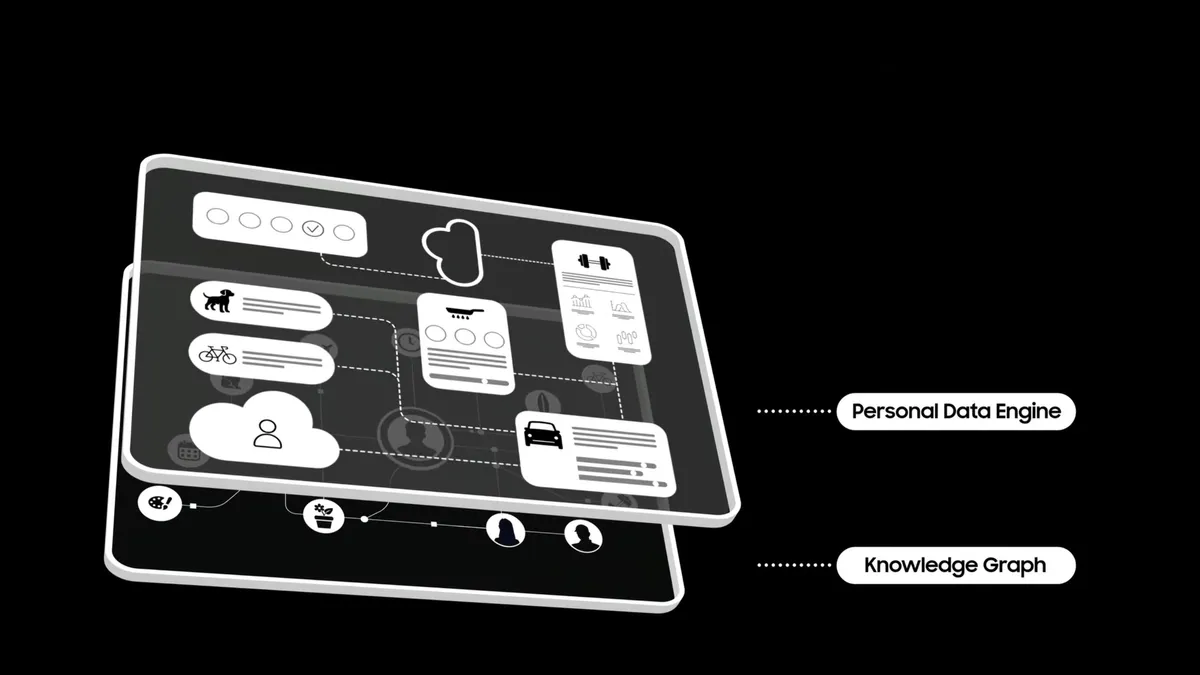

Samsung отметила, что новые инструменты и функции ИИ доступны благодаря новому специализированному чипу Snapdragon с ультрамощным нейронным процессором. Многое зависит именно от него. Еще одна упомянутая составляющая — это граф знаний (семантическая сеть, в которой хранится информация о разных сущностях и взаимосвязях между ними), построенный на том, что вы делаете, где, когда и как вы это делаете. И то и другое используется для воплощения агентного ИИ в жизнь внутри маленького смартфона.

Посмотрим, как агентный ИИ работает на фабрике, поскольку он уже туда внедрен. Например, кто-то сообщает программному обеспечению, что требуется, скажем, 20 000 каких-то штук, готовых и упакованных для отправки через пять дней.

Сотрудники программируют отдельные автоматизированные линии, которые выполняют различные работы, необходимые для создания штуки. Это похоже на данные, которые вы добавляете в свой собственный граф знаний на своем телефоне — вы сообщаете программному обеспечению рецепт и ингредиенты для конечного результата.

Агентный ИИ контролирует всю операцию целиком. Он знает, сколько штук нужно закончить и когда они потребуются, поэтому он настраивает отдельные параметры для достижения цели наиболее эффективным способом. Например, если одна линия, производящая деталь, останавливается на техобслуживание, ИИ может увеличить производительность другой линии, производящей ту же деталь, пока техобслуживание не будет завершено. Если упаковочная линия выключается, ИИ может остановить все необходимые процессы, чтобы не перегружать ее во время простоя.

Все это рутинные задачи, но ПО было запрограммировано на то, чтобы следить за ними, анализировать полученные данные и, руководствуясь ими, принимать обоснованные решения.

В вашем смартфоне агентный ИИ хранит все данные обо всем, что вы делаете со своими устройствами, в одном месте. Когда вы просите о чем-то ИИ, скажем, найти фотографию заката в таком-то месте такого-то числа или подсказать, сколько вам нужно бегать каждый день, чтобы сжечь еще чуток калорий, он просматривает эти данные и анализирует то, что находит.

Затем он решает, какие данные более полезны, какие вообще не следует использовать, а какие наиболее важны для предоставления вам того, что вы запросили. Если он видит 100 фотографий в указанном месте, 1300 фотографий, сделанных в нужный день, и 71 фотографию закатов, он перепроверяет данные, чтобы увидеть, получены ли какие-либо из них с одной и той же фотографии. Если это так, то именно это он вам и показывает. Если нет, то тогда он даст отрицательный ответ в той форме, в которой его запрограммировали.

Функция работает автономно, так что вы можете, к примеру, получить уведомление о том, что вам нужно выйти на работу на 20 минут раньше, потому что на вашем обычном маршруте произошла авария и вам стоит выбрать другой путь. И, кстати, возьмите с собой зонтик, даже если сейчас солнечно, потому что позже пойдет дождь. А вот здесь вы можете выпить кофе, потому что кафе, куда вы обычно заходите, будет вам не по пути.

Насколько хорошо будет работать этот новый Galaxy AI, нам еще предстоит оценить. На первый взгляд, все это мало чем отличается от того, что наши телефоны уже могут делать для нас или сообщать нам. Но конкретно данная технология — большой шаг вперед, и когда какой-нибудь талантливый инженер задумает что-то новое, гораздо большее станет возможным.

Прим. редактора. Неясно, как эти функции будут работать в России, но пока именно такие доработки ИИ, которые никак не видны глазу и даже кажется, что нечто похожее есть у всех, могут оказаться теми шагами вперед, которые и демонстрируют истинную инновационность смартфонов. В этом отношении Galaxy S25 — действительно существенно обновленный аппарат, несмотря на то, что он не прибавил мегапикселей и разительно не поменялся по дизайну. Еще интереснее будет увидеть ответ Apple, ведь именно уникальный по гладкости пользовательский опыт был тем, за что переплачивали, выбирая iPhone. Теперь же Google и Samsung перебросили мяч на чужую половину поля и могут забить решающий гол, если в Купертино продолжат так же пренебрежимо мало давать своим пользователям в области ИИ.