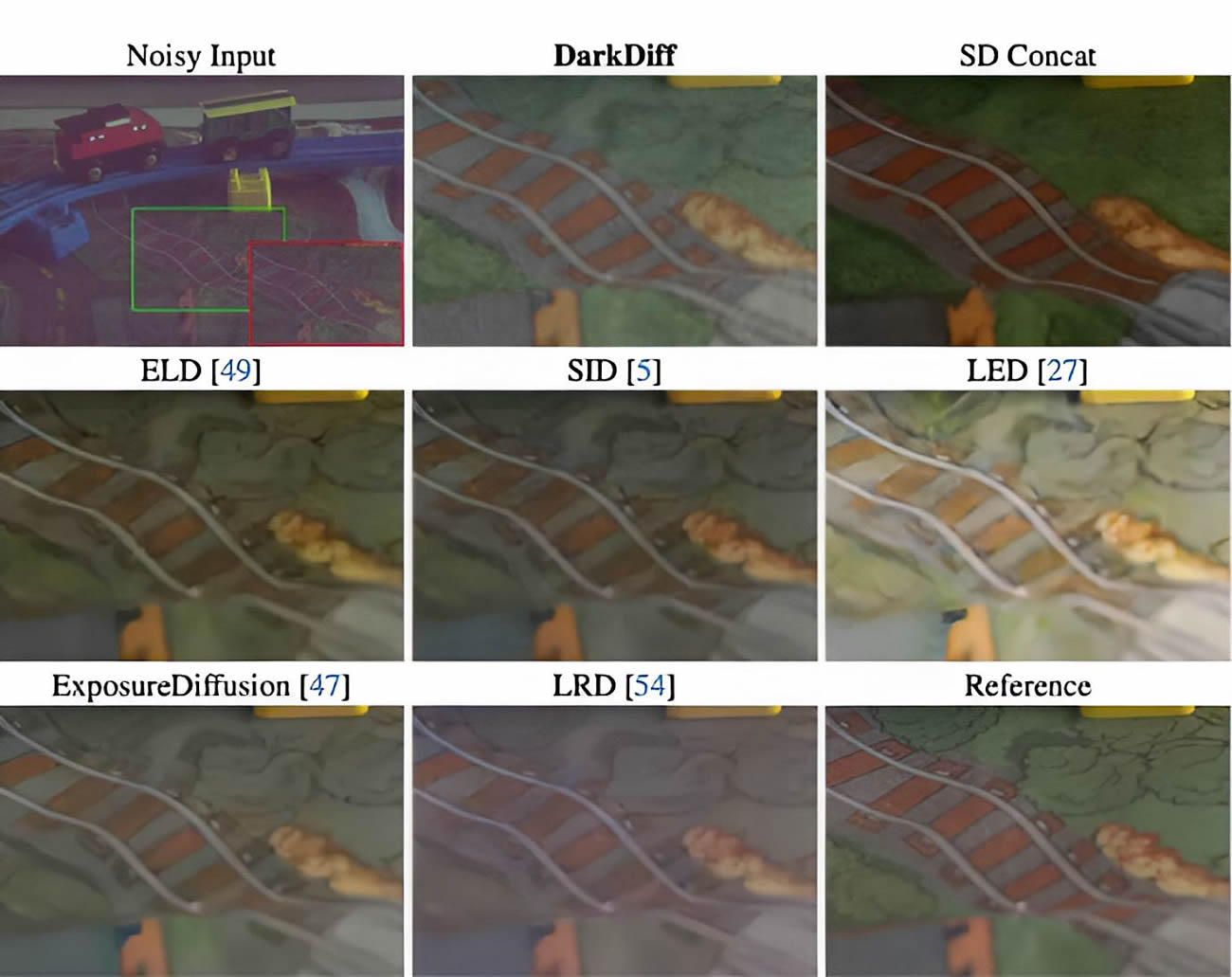

Исследователи Apple в сотрудничестве с Университетом Пердью (Purdue University) разработали новую систему улучшения фотографий, сделанных на iPhone, в условиях крайне слабого освещения. Система на основе искусственного интеллекта (ИИ) получила название DarkDiff. В отличие от традиционных алгоритмов обработки изображений, которые часто «размазывают» детали и создают неестественные текстуры, DarkDiff интегрирует диффузионную модель прямо в конвейер обработки сигнала камеры (ISP). Модель основана на адаптации предобученной генеративной диффузионной архитектуры, в частности, Stable Diffusion, и применяется не при постобработке, а на этапе преобразования «сырых» данных с сенсора. Это выглядит так: система сохраняет ранние этапы ISP, такие как баланс белого и умное достраивание недостающей цветовой информации (demosaicing), а затем применяет диффузионное моделирование к линейному RGB-изображению, напрямую формируя финальное sRGB-изображение.

Так как DarkDiff использует механизм вычисления по локальным фрагментам снимка, это помогает ИИ смягчить галлюцинации и сохранить структуру объектов. Управление детализацией осуществляется с помощью метода CFG (classifier free guidance): чем выше значение, тем чётче текстуры, однако и выше риск артефактов. В тестах, проведённых на реальных снимках, сделанных ночью с выдержкой всего 0,033 секунды, DarkDiff превзошёл существующие на сегодня методы по качеству, оцениваемому на глаз. Однако метод требует значительных вычислительных ресурсов и пока не оптимизирован для работы на устройстве без подключения к облаку. Кроме того, несмотря на успехи технологии, авторы исследования не обещают скорого внедрения DarkDiff в iPhone, а также указывают на трудности с распознаванием неанглийских надписей в темноте.